本内容は2023年9月に公開したグローバルブログの抄訳版です。

生成AIは急速に普及していますが、AIの運用プロセスは追いついていません。 実際、どんどん取り残されています。そして、それはあらゆるチームにとって大きな問題でもあります。 LLM(大規模言語モデル)を幅広いビジネスイニシアチブに導入したいという要望はありますが、チームはLLMを安全に導入・運用することができません。 導入リーダーは今、生成AIと予測AIの両方で、さらに多くの複雑なスタックを作成するという課題に直面しています。 それは、個別の技術とツール、より多くのデータサイロ、より多くの追跡すべきモデル、そしてより多くの運用と監視という問題です。 生産性が低下し、モデルのパフォーマンス、信頼性、正確性に関するオブザーバビリティと明確さが不足することでリスクが生じます。

すでに限界に達している機械学習チームやデータサイエンスチームにとって、スケールアップは非常に困難です。 彼らは今、LLMの要求で過負荷になっているだけでなく、既存の予測モデルと運用プロセスをやりくりしながら、将来の問題やメンテナンスのリスクとなる可能性を持つLLMの決定に悩まされています。 これは、AIの運用を混乱させる原因となります。

これこそが、チームが運用プロセスと統合された生成AIを使用して、LLMを安全かつ確実に使用できるようにするために、生成AIを搭載したAI運用に関する製品拡張を発表する理由です。 DataRobotは、エンタープライズ規模の生成AIデプロイメントを予測AIと並行して監視および管理が可能です。 ここからは詳細をご紹介します。

AIチームはLLMの信頼性の問題に対処する必要がある

昨年の間、ずっと洞穴に隠れていたり、2000年代のリアリティ番組だけを見ていた人でない限り、LLMの台頭と優位性について聞いたことがあるでしょう。 本ブログを読んでいる場合、日常的にLLMを使用しているか、組織がワークフローにLLMを組み込んでいる可能性が高いと思います。 しかし、LLMは残念ながら、厳密に管理されていない限り、自信に満ちた、もっともらしく聞こえる誤った情報を提供する傾向があります。 組織がLLMから真の具体的な価値を得るには、管理された方法でLLMをデプロイすることが最善の戦略です。 具体的には、法的または評判のリスクを回避するために、LLMを安全かつ管理された状態にすることです。 だからこそ、LLMOpsは、生成AIプロジェクトから自信を持って価値を引き出したいと考えている組織にとって非常に重要です。 しかし、どの組織においても、LLMは単独で存在するのではなく、単なる1種類のモデルであり、はるかに大きなAIおよびMLエコシステムの一部です。

すべてのモデルの監視を管理する時が来た

これまで、組織は増え続ける予測MLモデルを監視および管理し、ビジネスに必要な結果が得られるようにするために苦労してきました。 しかし、生成AIモデルの爆発的な増加により、監視の問題はさらに深刻化しています。 予測モデル、そして今では生成モデルがビジネス全体に急増するにつれて、データサイエンスチームは、標準以下のビジネス成果とROIの低さまたはマイナスをもたらしているパフォーマンスの低いモデルを効率的かつ効果的に探し出すことがこれまで以上に困難になっています。

簡単に言えば、組織のあらゆる場所で予測モデルと生成モデルを監視することが、リスクを軽減し、パフォーマンスを確保するために不可欠です。 多くの場合、モデルの増加に伴う手作業を削減することは言うまでもありません。

LLMは、特にハルシネーションのリスクを管理するという、まったく新しい問題をもたらします。 基本的に、課題はLLMの信頼性の問題を大規模に管理することです。 組織は、運用化されたLLMが無礼な態度をとったり、誤った情報を提供したり、偏見を永続させたり、応答に機密情報を含めたりするリスクにさらされています。 これらすべてが、モデルの動作とパフォーマンスの監視を非常に重要にしています。

DataRobotが活躍するのはこの点です。 LLMの監視、統合、ガバナンスの広範な機能により、ユーザーはモデルを完全に可観測かつ制御しながら迅速にデプロイできます。 モデルレジストリを使用した自動モデルバージョニングとデプロイパイプラインを備えたモデル管理ツールスイート全体を使用することで、LLM(または従来のロジスティック回帰モデルでも)が制御不能になることを心配する必要はありません。

DataRobotの監視機能を拡張して、LLMの動作に関する洞察を提供し、期待される結果からの逸脱を特定できるようにしました。 また、企業はモデルのパフォーマンスを追跡し、SLAを遵守し、ガイドラインに準拠することで、デプロイ場所や構築者に関係なく、すべてのモデルの倫理的かつガイド付きの使用を保証できます。

実際、予測から生成、すべてのLLMを含むすべてのモデルタイプに対して堅牢な監視サポートを提供し、組織が次のことを追跡できるようにします。

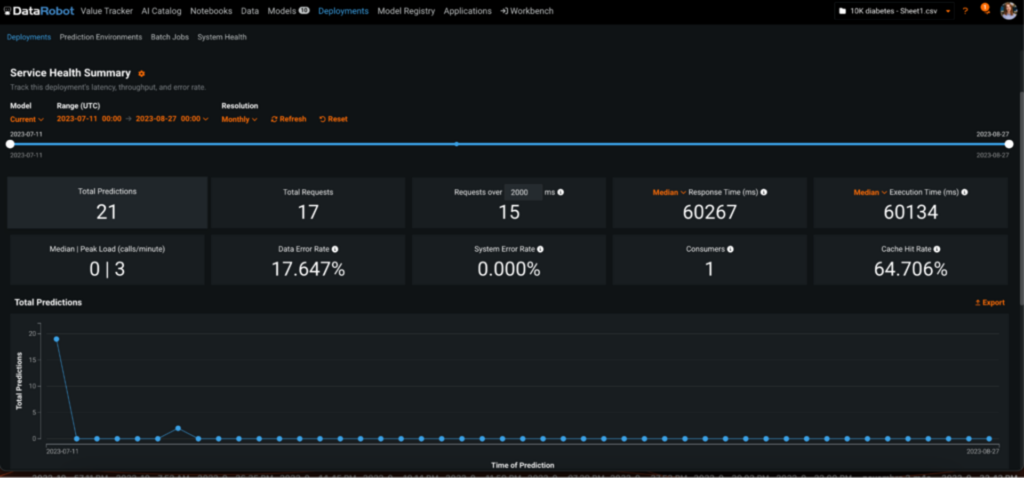

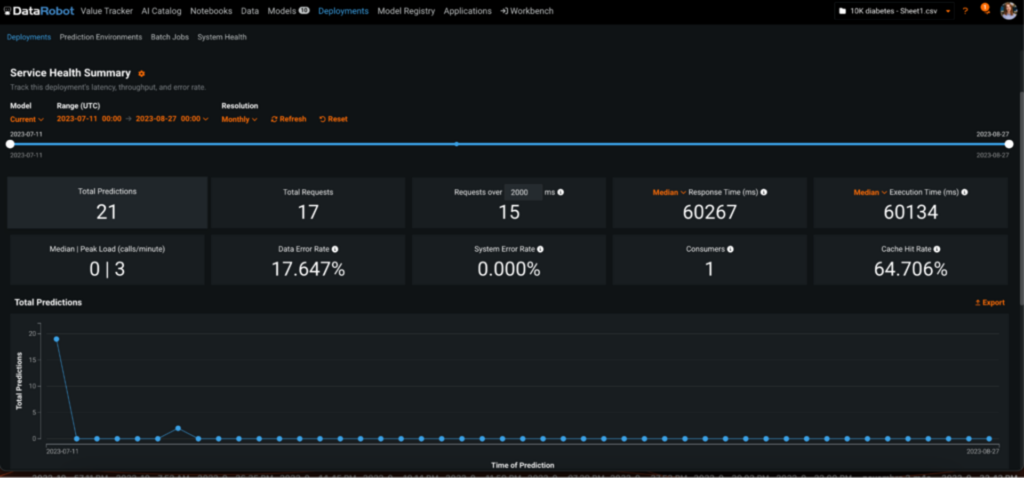

・サービスの健全性:パイプラインに問題がないことを確認するために追跡することが重要です。 ユーザーは、リクエスト、完了、プロンプトの総数、応答時間、実行時間、中央値とピーク負荷、データとシステムのエラー、コンシューマーの数、キャッシュヒット率を追跡できます。

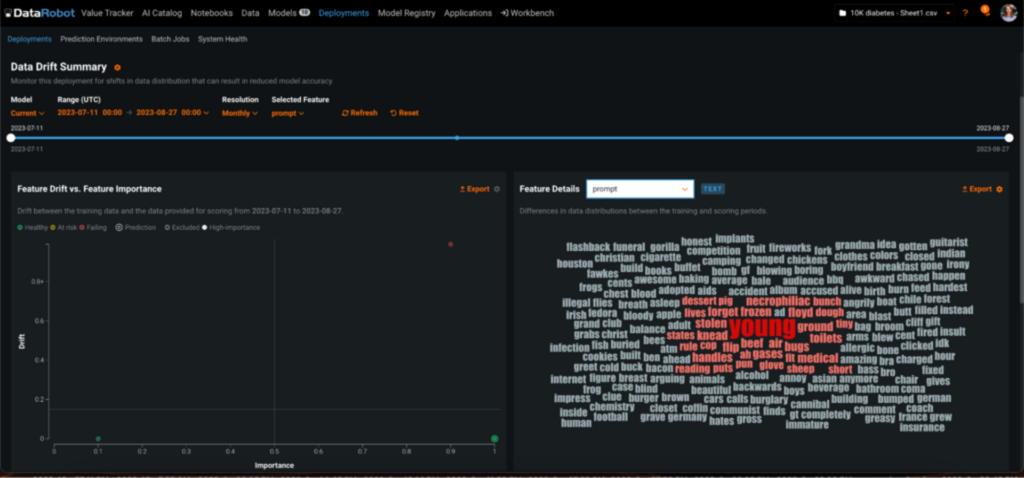

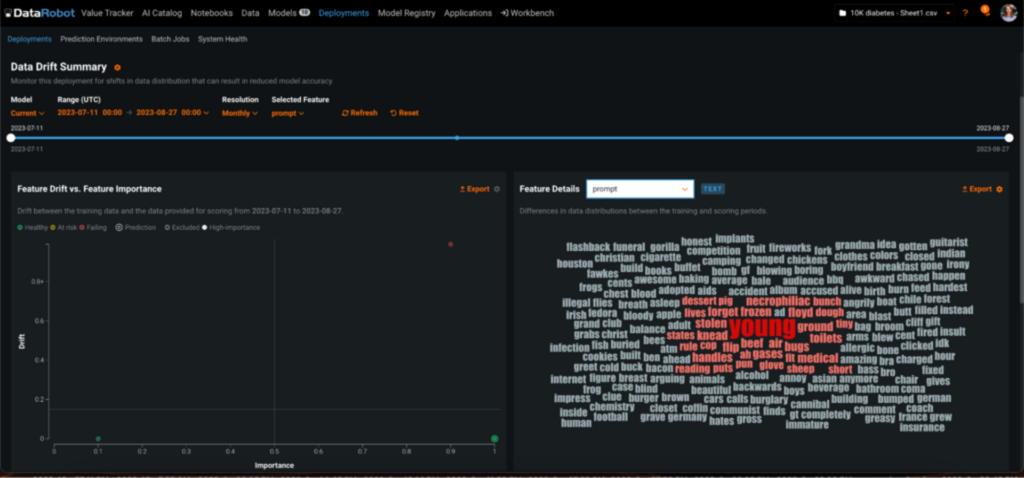

・データドリフトの追跡:データは時間とともに変化し、数か月前にトレーニングしたモデルのパフォーマンスはすでに低下している可能性があり、コストがかかる可能性があります。 ユーザーは、データドリフトとパフォーマンスを長期にわたって追跡し、完了、温度、その他のLLM固有のパラメーターを追跡することもできます。

・カスタム指標:カスタム指標フレームワークを使用して、ユーザーはカスタムビルドモデルまたはLLMに合わせて特別に調整された独自のメトリックを作成できます。 毒性監視、LLMの使用コスト、トピックの関連性などのメトリックは、ビジネスの評判を保護するだけでなく、LLMが「トピックから外れない」ようにすることもできます。

生成AIアプリ内でユーザーインタラクションをキャプチャし、それらをモデル構築フェーズにフィードバックすることで、プロンプトエンジニアリングとファインチューニングを改善できる可能性が非常に大きくなります。 この反復的なプロセスにより、実際のユーザーアクティビティに基づいてプロンプトを改良できるため、ユーザーとAIシステム間のコミュニケーションがより効果的になります。 AIがユーザーのニーズにより適切に対応できるようになるだけでなく、より優れたLLMを作成するのにも役立ちます。

すべての生成モデルと運用モデルをコマンドアンドコントロール

LLMを採用しようと急ぐ中で、データサイエンスチームは別のリスクに直面しています。 今、選択したLLMが、6か月後に使用するLLMになるとは限りません。 2年後には、別のクラウドで実行したいまったく異なるモデルになっている可能性があります。 LLMのイノベーションが急速に進んでいるため、技術的負債が発生するリスクは、数年ではなく数か月で現実のものとなります。また、チームが生成AIをデプロイしようと急ぐ中で、企業をリスクにさらす不正なモデルをチームがスピンアップしてしまうことは、これまでになく簡単になっています。

組織は、既存のモデルに加えて、LLMを安全に採用し、管理、追跡、プラグアンドプレイする方法が必要です。 そうすれば、チームは変化から守られます。

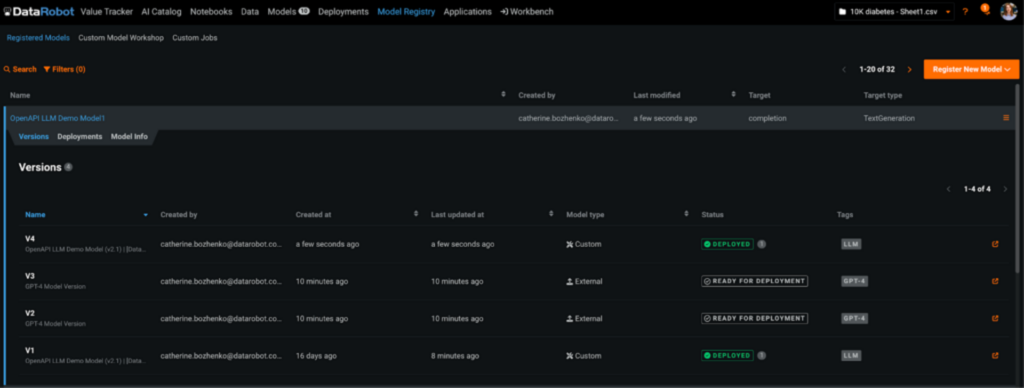

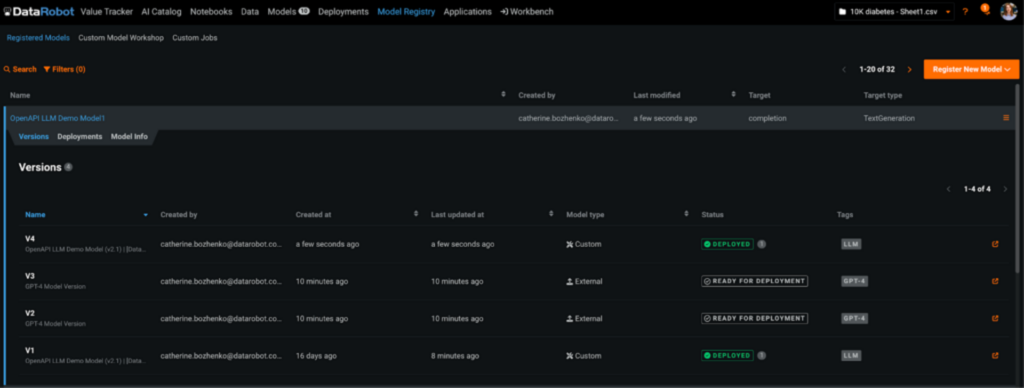

だからこそ、AIおよびML運用の基礎となるコンポーネントであるDatarobotのモデルレジストリをアップグレードしました。これにより、生成AIと予測AIの両方を整理および追跡するための完全に構造化され、管理されたアプローチと、LLM採用の全体的な進化が実現します。 モデルレジストリを使用すると、GPT-3.5、GPT-4、LaMDA、LLaMa、Orcaなどの一般的なバージョンであっても、カスタムビルドのモデルであっても、あらゆるLLMに接続できます。 構築またはデプロイされた場所に関係なく、すべてのモデルの集中リポジトリがユーザーに提供されるため、効率的なモデル管理、バージョニング、デプロイが可能になります。

データや要件の変化により、すべてのモデルは時間とともに進化しますが、モデルレジストリに組み込まれているバージョニングは、ユーザーがこれらの変更のトレーサビリティと制御を確保するのに役立ちます。 彼らは自信を持って新しいバージョンにアップグレードでき、必要に応じて、以前のデプロイに簡単にロールバックできます。 このレベルの制御は、あらゆるモデル、特にLLMが運用環境で最適に機能することを保証するために不可欠です。

DataRobotモデルレジストリを使用すると、ユーザーは従来の予測モデルとLLMを完全に制御できます。 これらのモデルの組み立て、テスト、登録、デプロイは、すべて単一のペインから簡単に行えます。

多様性と柔軟性のメリットを解放する

変化に適応することが重要です。なぜなら、言語から創造的なタスクまで、さまざまな目的に適したさまざまなLLMが常に登場しているからです。

運用プロセスには、変化に適応するための多様性と、1つのモデルに無理やり合わせるのではなく、ユースケースに適した生成モデルまたは予測モデルをプラグアンドプレイできる柔軟性が必要です。 DataRobotでは、モデルをリモートまたはDataRobotにデプロイできるため、ユーザーは予測タスクと生成タスクの両方に対して多様なオプションを利用できます。

また、DataRobot Prediction APIを使用してさらに一歩進んだことで、ユーザーはカスタムビルドモデルまたは好みのLLMをアプリケーションに柔軟に統合できるようになりました。 たとえば、リアルタイムのテキスト生成やコンテンツ作成をアプリケーションにすばやく簡単に追加できるようになりました。

Prediction APIを活用して、ユーザーがLLMでバッチジョブを実行できるようにしました。 たとえば、記事や製品の説明など、大量のコンテンツを自動的に生成する必要がある場合は、DataRobotを活用してLLMでバッチ処理を処理できます。

さらに、LLMはインターネット接続が制限されているエッジデバイスにもデプロイできるため、DataRobotを活用して、それらのデバイスでもコンテンツを直接生成できます。

DataRobotは、生成AIと予測AIを確実、効率的、安全に拡張できるように設計されている

DataRobotは、リーダーが生成AIと予測AIのイニシアチブを統合、管理、調和させ、結果を監視し、将来を見据えたものにするための新しい方法を提供します。 これにより、チームは生成AIと予測AIのどちらであっても、より多くのモデルをスケーラブルに提供し、それらをすべて監視して最高のビジネス成果を上げていることを確認できるため、ビジネスの持続可能な方法でモデルを成長させることができます。 チームは、AIイニシアチブ全体の運用プロセスを一元化し、すべてのモデルを管理して、より強力なガバナンスを実現し、クラウドベンダーまたはLLMモデルのロックインを削減できるようになりました。

生産性の向上、柔軟性の向上、競争上の優位性の向上、より良い結果、リスクの軽減。これは、すべてのAIイニシアチブを価値主導型にすることです。

執筆者について

DataRobotは、ビジネスへの影響を最大化し、リスクを最小限に抑えるAIを提供しています。当社のAIアプリケーションとプラットフォームは、コアビジネスプロセスに統合され、チームがAIを開発、提供、管理することを支援します。DataRobotは、実務担当者が予測および生成AIを提供し、リーダーがAI資産を保護することを可能にします。世界中の組織が、現在そして将来にわたり、ビジネスに役立つAIを提供するDataRobotに信頼を寄せています。詳細については、当社のウェブサイトをご覧ください。LinkedInのフォローもお待ちしています。