DataRobot Japanの副社長をしています小川です。生成AIの登場によって他業種、他職種でもAIの注目度が上がっています。私自身、サイバーセキュリティ領域におけるAIの活用に関して講演する機会が増えています。本ブログでは、講演内容の一部である「AI時代におけるサイバーセキュリティの重要性」についてまとめています。

AI時代のサイバーセキュリティ:攻防の最前線とAIガバナンスの重要性 – 多層防御とAI検知の相乗効果

AI技術は目覚ましい発展を遂げ、社会の様々な分野で活用されていますが、その一方で、サイバー攻撃や金融不正などの悪用も増加しており、企業や組織にとって大きな脅威となっています。

従来のサイバーセキュリティ対策では、既知の攻撃パターンに基づいたルールやシグネチャを用いて脅威を検知していました。しかし、AIを活用した攻撃は、これらの防御を容易に回避できるようになっています。例えば、フィッシングメールの高度化やディープフェイクによる顔認証の突破など、巧妙な手法が次々と登場しています。

AIによる防御:多層防御と継続的な進化 – AI検知の精度向上

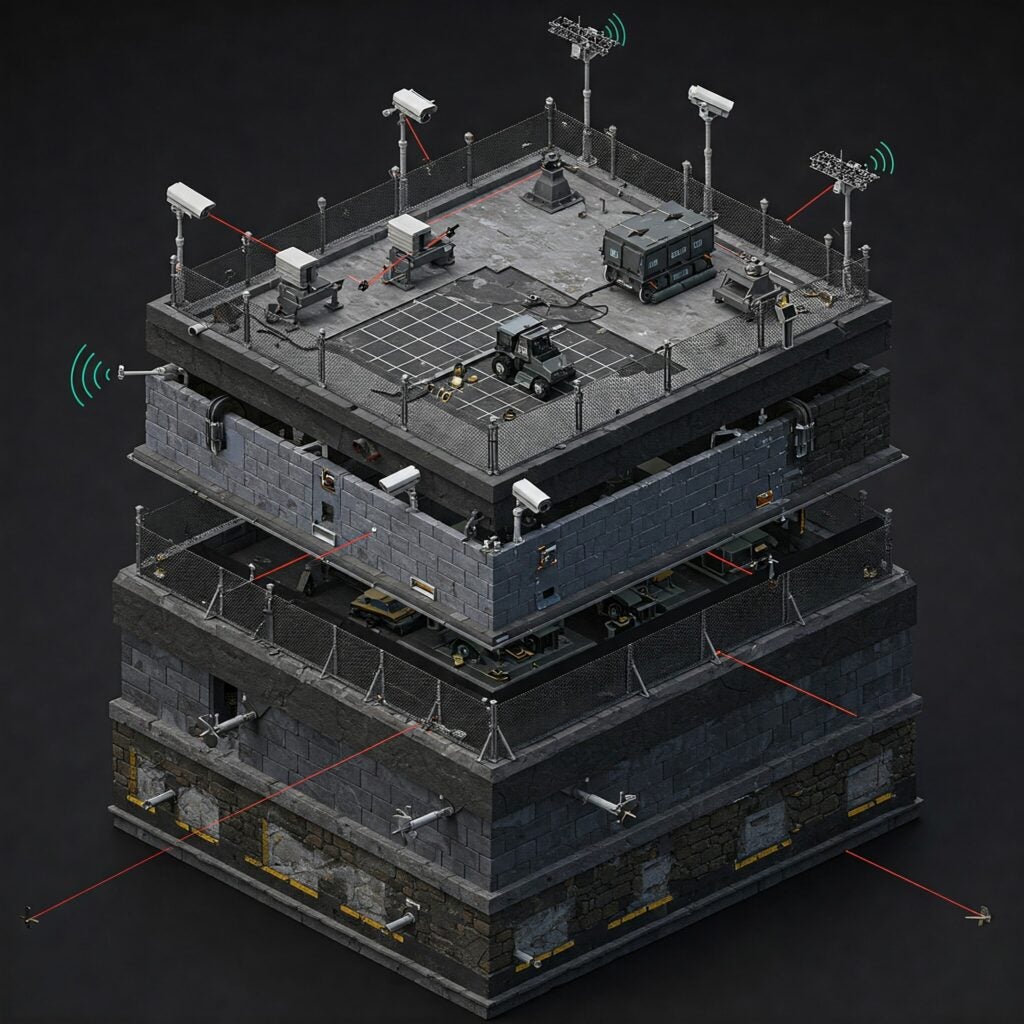

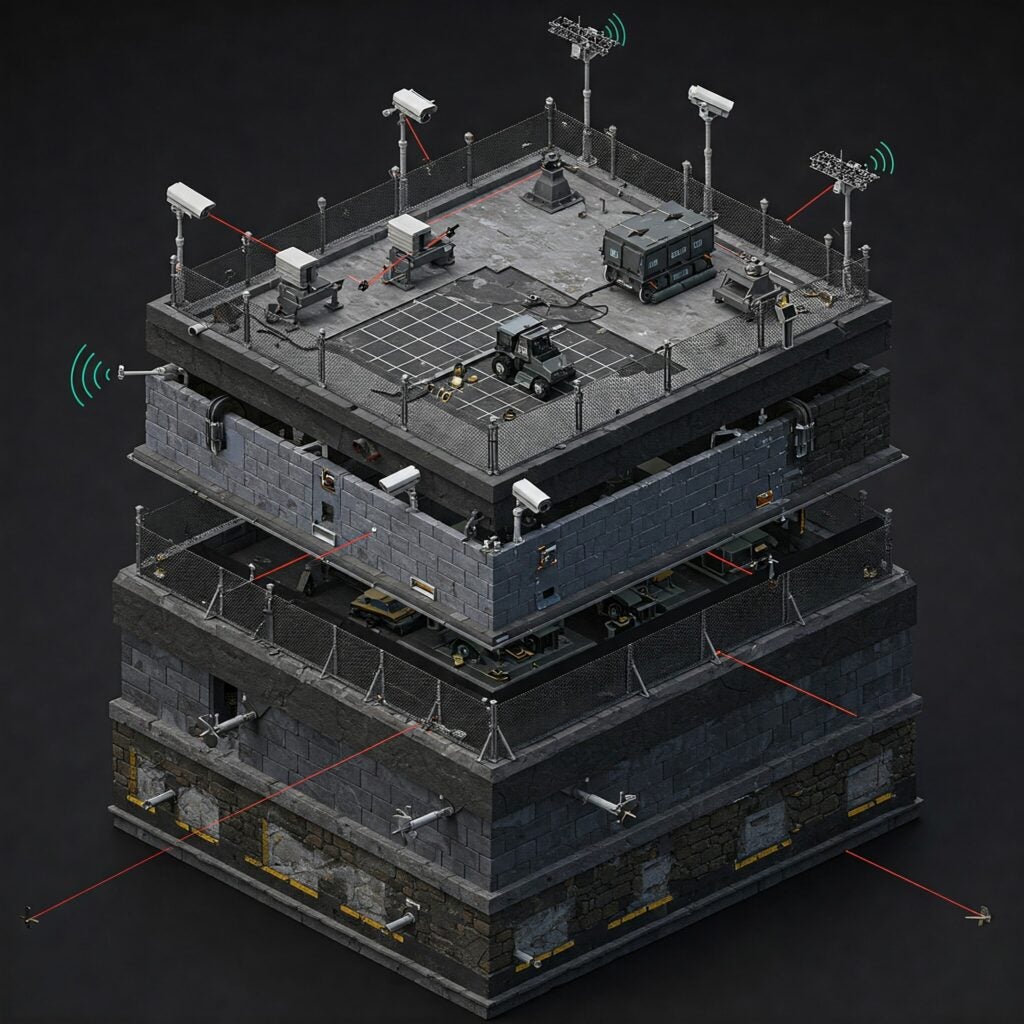

多層防御のイメージ図。AI検知も一つの防御層でしかない。

多層防御のイメージ図。AI検知も一つの防御層でしかない。

このような状況下で、サイバーセキュリティ対策においてもAIの活用が不可欠となっています。AIは、大量のデータを高速に分析し、脅威を検知することができます。また、攻撃者の行動パターンを学習し、対策を講じることも可能です。

しかし、AIを導入すればそれで終わりではありません。サイバー攻撃の手法は常に進化しており、AIのモデルも継続的に更新していく必要があります。AIの能力を最大限に引き出すためには、多層防御の考え方が重要です。 多層防御とは、複数の異なるセキュリティ対策を組み合わせることで、単一の対策では防ぎきれない脅威を検知し、防御する仕組みです。

多層防御が重要な理由は、多層防御が整っていないと通常のアクセスやトランザクションと不正やサイバー攻撃の見分けがつかず、AIでも検知ができないためです。 例えば、金融機関における不正送金の場合、通常の送金と不正送金を区別するためには、利用チャネル、送金額、時間帯、送金先、過去の取引履歴など、複数の要素を考慮する必要があります。

多層防御を行うことによって、より不正がそれらを回避するために独特の動きとなり、AI検知の精度アップにもつながるWin-Winの関係になっています。 AIは、これらの要素を学習し、不正な取引を検知することができます。しかし、多層防御が整っていなければ、AIは十分な情報を得ることができず、誤検知や見逃しが発生する可能性があります。

AIによる検知に加えて、ファイアウォールや侵入検知システム(IDS)など、既存のセキュリティ対策と連携することで、多角的な視点から脅威を検知し、対応することができます。

攻撃側の進化:AIモデルへの攻撃 – 生成AIによる巧妙化

フィッシングメールを生成AIで作成したもの。

フィッシングメールを生成AIで作成したもの。

日本語の不自然さなどは感じられない。

AIの進化は、攻撃側にとっても新たな可能性をもたらしています。攻撃者は、AIの特性を悪用し、防御システムを欺こうとします。データに意図的にノイズを混入させ、AIモデルの精度を低下させる攻撃手法も確認されていますが、近年では、生成AIを利用した攻撃手法が高度化し、新たな脅威となっています。

生成AIは、テキスト、画像、音声、動画など、様々な種類のデータを生成することができます。攻撃者は、この生成AIを利用して、以下のような攻撃を仕掛けてきます。

- フィッシングの高度化: 従来のフィッシングメールは、不自然な日本語や文法エラーなどが多く、比較的見破りやすかったと言えます。しかし、生成AIを利用することで、より自然な日本語で書かれた、巧妙なフィッシングメールを作成することが可能になります。また、受信者の属性や興味・関心に合わせたパーソナライズされたメールを作成することで、クリック率や詐欺被害の増加を狙うこともできます。

- 生体認証の突破: 顔認証や音声認証などの生体認証システムは、セキュリティ対策として広く普及しています。しかし、生成AIを利用することで、本物そっくりの顔画像や音声データを生成し、生体認証システムを欺くことが可能になります。例えば、ディープフェイクと呼ばれる技術は、既存の画像や動画を元に、本物と見分けがつかないほどリアルな顔画像や動画を生成することができます。

- マルウェアの自動生成: 生成AIは、新たなマルウェアの自動生成にも利用される可能性があります。従来のマルウェアは、既知のコードを組み合わせたり、一部を変更したりすることで作成されていましたが、生成AIを利用することで、全く新しいコードを持つマルウェアが生まれるかもしれません。これにより、従来のセキュリティ対策では検知が難しいマルウェアが登場し、被害が拡大する危険性をはらんでいます。

これらの攻撃手法は、従来のセキュリティ対策では防ぎきれない可能性が高く、新たな対策の必要性が高まっています。具体的には、以下のような対策が考えられます。

- セキュリティ人材の育成: 生成AIを利用した攻撃に対抗するためには、高度なセキュリティ知識を持つ人材の育成が不可欠です。

- AIモデルのロバスト性向上: 攻撃に強いAIモデルを開発するために、敵対的サンプルを用いた学習や、AIモデルの脆弱性診断などを実施する必要があります。

- 多層防御の強化: AIによる検知に加えて、従来のセキュリティ対策と組み合わせることで、より強固な防御体制を構築する必要があります。

生成AIは、サイバーセキュリティの分野においても、攻防の新たな局面を切り開いています。攻撃者は、生成AIを利用してより巧妙な攻撃を仕掛けてくることが予想されます。防御側は、生成AIの特性を理解し、適切な対策を講じることで、サイバー攻撃から身を守り、安全なデジタル社会を実現していく必要があります。

組織としての課題:AIガバナンスの確立と情報共有の促進

モデルリスク管理を含んだAIモデルライフサイクル

モデルリスク管理を含んだAIモデルライフサイクル

AIを活用したサイバーセキュリティ対策を効果的に行うためには、組織全体でAIガバナンスを確立し、情報共有を促進することが重要です。特に、以下の点が課題となります。

- 情報共有の促進: サイバー攻撃に関する情報は、組織を跨いで共有することが重要です。トップラインに関わるAI活用は競争領域とも絡み共有が難しい場合もありますが、防御に関わるAIは、組織全体で共有し、連携して対策を講じる必要があります。

- AIガバナンスの強化: AIのセキュリティホールを防ぐためには、AIガバナンスが重要です。しかし、ガバナンス部門はその実態を知らない人からは、しばしば「売上に貢献しない仕事」とみなされ、人材確保が難しいという現状があります。過学習検知など、高度な専門知識を持つ人材が必要とされるにも関わらず、日本では待遇面やキャリアパスが魅力的でないため、優秀な人材が集まりにくい状況に陥っています。

【提言】AIガバナンス強化:シニアデータサイエンティストのモチベーション向上

AIガバナンスを強化するためには、高度な専門知識を持つ人材の確保が不可欠です。特に、シニアデータサイエンティストは、AIモデルの開発や運用、評価など、幅広い知識や経験を有しており、AIガバナンスにおいても重要な役割を担うことができます。

しかし、従来のガバナンス部門は、ルールや規制の遵守に関するチェックを行う業務に重要点が置かれるため、シニアデータサイエンティストにとって魅力的な職場環境とは言えない場合がありました。単純作業やドキュメント作成、承認フローのチェックなど、彼らのスキルや能力を活かしきれない業務が多く、モチベーションの低下や離職に繋がる可能性も懸念されます。

AIガバナンスを強化し、シニアデータサイエンティストの能力を最大限に引き出すためには、彼らがやりがいを感じられるような職場環境を提供することが重要です。具体的には、以下のような取り組みが考えられます。

- 高度な分析・評価タスクの付与: AIモデルの精度評価やバイアス検知、セキュリティ脆弱性診断など、高度な分析スキルや専門知識を必要とするタスクを任せることで、シニアデータサイエンティストの知的好奇心とチャレンジ精神を刺激することができます。

- AIガバナンス戦略への参画: AIガバナンスの戦略策定や意思決定プロセスにシニアデータサイエンティストを積極的に関与させることで、彼らの意見やアイデアを反映し、より効果的なガバナンス体制を構築することができます。

- 最新技術の研究・開発機会の提供: AIガバナンスに関する最新技術や手法の研究開発に携わる機会を提供することで、シニアデータサイエンティストの学習意欲を高め、常に最先端の知識を習得できる環境を整備することができます。

- 自律的な意思決定と裁量の付与: シニアデータサイエンティストに、AIガバナンスに関する一定の権限と裁量を委任することで、責任感と主体性を高め、より積極的に業務に取り組むことができるようにします。

これらの取り組みを通じて、シニアデータサイエンティストがAIガバナンスにおいて重要な役割を担い、やりがいを感じながら活躍できる環境を整備することで、組織全体のAIガバナンス強化に繋げることが可能となります。

これまでの「売上に貢献しない仕事」というイメージを払拭し、シニアデータサイエンティストにとって魅力的な職場環境を整備することが、AIガバナンス強化の鍵となります。

情報共有の促進:オープンな協調体制の構築

サイバー攻撃に関する情報は、組織を跨いで共有することが重要です。特に、防御に関わるAIは、競争領域とは異なり、よりオープンな情報共有が可能です。具体的なノウハウを広く共有し、人材交流も行いながら最新事例を共有化していく仕組み作りが大切です。

従来、企業はセキュリティ対策に関する情報を秘匿する傾向がありました。しかし、サイバー攻撃の巧妙化・複雑化が進む中で、個々の企業が単独で対策を講じることには限界があります。そこで、近年では、セキュリティに関する情報共有や共同研究の重要性が認識されつつあります。

特に、防御に関わるAI技術は、攻撃手法や防御方法など、多くの企業にとって共通の課題です。AIモデルの学習データ、アルゴリズム、評価指標などを共有することで、各企業はより効率的にAIセキュリティ対策を強化することができます。また、人材交流を通じて、専門知識や経験を共有し、相互にスキルアップを図ることも可能です。

具体的な情報共有の仕組みとしては、以下のようなものが考えられます。

- 業界団体やコミュニティによる情報共有プラットフォームの構築

- 共同研究やワーキンググループの設立

- セキュリティ人材の交流

これらの取り組みを通じて、企業間の連携を強化し、サイバーセキュリティ対策における集合知を形成することで、より効果的な防御体制を構築することが可能となります。

防御に関わるAIは、競争領域ではなく、協調領域です。 オープンな情報共有と人材交流を通じて、サイバーセキュリティの強化に取り組むことが重要です。

AI時代のサイバーセキュリティに関する結論

AI技術は、サイバーセキュリティの世界において、攻守両面で重要な役割を果たしています。攻撃者はAIを利用してより巧妙な攻撃を仕掛け、防御側はAIを利用してこれらの攻撃を検知し、防御する必要があります。AIを導入するだけでなく、その特性を理解し、多層防御と連携した適切なガバナンス体制を構築することが、AI時代のサイバーセキュリティ対策において最も重要な要素となります。

DataRobot JapanではAIの民主化という人材育成だけではなく、ガバナンスの構築や不正対策としての個別AIテーマへの伴奏支援などを提供しています。この分野またはAIガバナンスなどにご興味があるかたはぜひご連絡ください。

DataRobotトライアルのご案内

DataRobotでは、トライアル環境を提供しています。

こちらからアカウントを作成し、DataRobotの主要な機能をお試しいただけます。

執筆者について

小川 幹雄

DataRobot Japan

VP, Japan Applied AI Experts

DataRobot Japan創立期に立ち上げメンバーとして参画。インフラからプロダクトマネジメント業、パートナリング業までDataRobotのビジネスにおけるあらゆる業務を担当し、ビジネス拡大に貢献。その後、金融業界を担当するディレクター兼リードデータサイエンティストとして、金融機関のお客様のAI導入支援からCoE構築支援をリード。2023年より、全てのお客様における価値創出を実現するため、日本のAIエキスパート部門の統括責任者に就任。豊富なAI導入・活用支援のノウハウから公共機関、大学機関における講演も多数担当。2022年より一般社団法人金融データ活用推進協会(FDUA)における企画出版委員会の副委員長に就任。